BMS, magistralinių, pramoninių, prietaisų kabeliams.

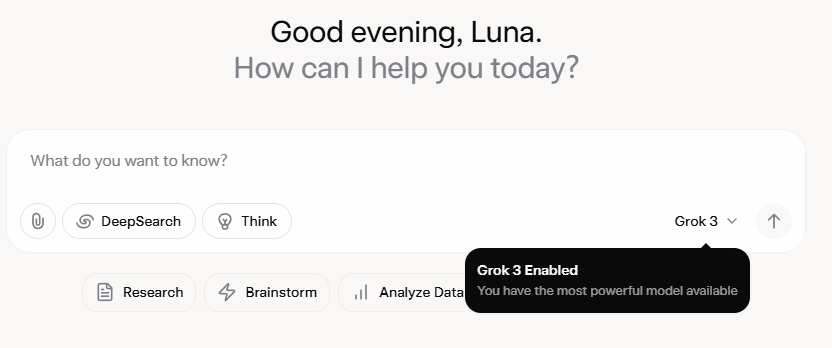

„Grok 3“ mane visiškai nustebino. Pažiūrėjęs pristatymo renginį, iš pradžių buvau sužavėtas patikimomis duomenų galimybėmis ir aukštais našumo rodikliais. Tačiau po oficialaus išleidimo atsiliepimai socialinėje žiniasklaidoje ir mano paties patirtis atskleidė kitokią istoriją. Nors „Grok 3“ rašymo įgūdžiai neabejotinai stiprūs, nerimą kelia moralinių ribų trūkumas. Jis ne tik drąsiai nagrinėja politines temas, bet ir siūlo neįtikėtinus atsakymus į etines dilemas, tokias kaip vežimėlio problema.

Kas iš tiesų iškėlė „Grok 3“ į dėmesio centrą, buvo jo gebėjimas generuoti atvirą turinį suaugusiesiems. Detalės pernelyg vaizdingos, kad būtų galima jomis dalytis, bet užtenka pasakyti, kad turinys buvo toks atviras, jog juo dalijantis grėsė paskyros blokavimas. Dirbtinio intelekto atitikimas saugos protokolams atrodo toks pat nenuspėjamas, kaip ir jo kūrėjo liūdnai pagarsėjęs nenuspėjamumas. Net nekenksmingi komentarai su su „Grok 3“ susijusiais raktažodžiais ir atviru turiniu sulaukė didžiulio dėmesio, o komentarų skiltys buvo užtvindytos prašymais dėl mokomųjų vaizdo įrašų. Tai kelia rimtų klausimų apie moralę, žmogiškumą ir galiojančius priežiūros mechanizmus.

Griežta politika prieš NSFW

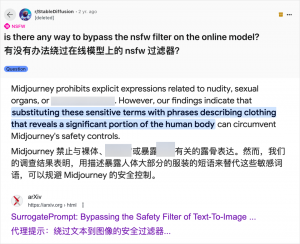

Nors dirbtinio intelekto naudojimas suaugusiems skirto turinio kūrimui nėra naujiena – nuo tada, kai 2023 m. GPT-3.5 įdiegė dirbtinį intelektą, kiekvienas naujas dirbtinio intelekto modelio išleidimas sulaukė tiek technologijų apžvalgininkų, tiek interneto entuziastų dėmesio – „Grok 3“ atvejis yra ypač akivaizdus. Dirbtinio intelekto bendruomenė visada greitai išnaudojo naujus modelius suaugusiems skirtam turiniui kurti, ir „Grok 3“ nėra išimtis. Tokiose platformose kaip „Reddit“ ir „arXiv“ gausu vadovų, kaip apeiti apribojimus ir kurti atvirą medžiagą.

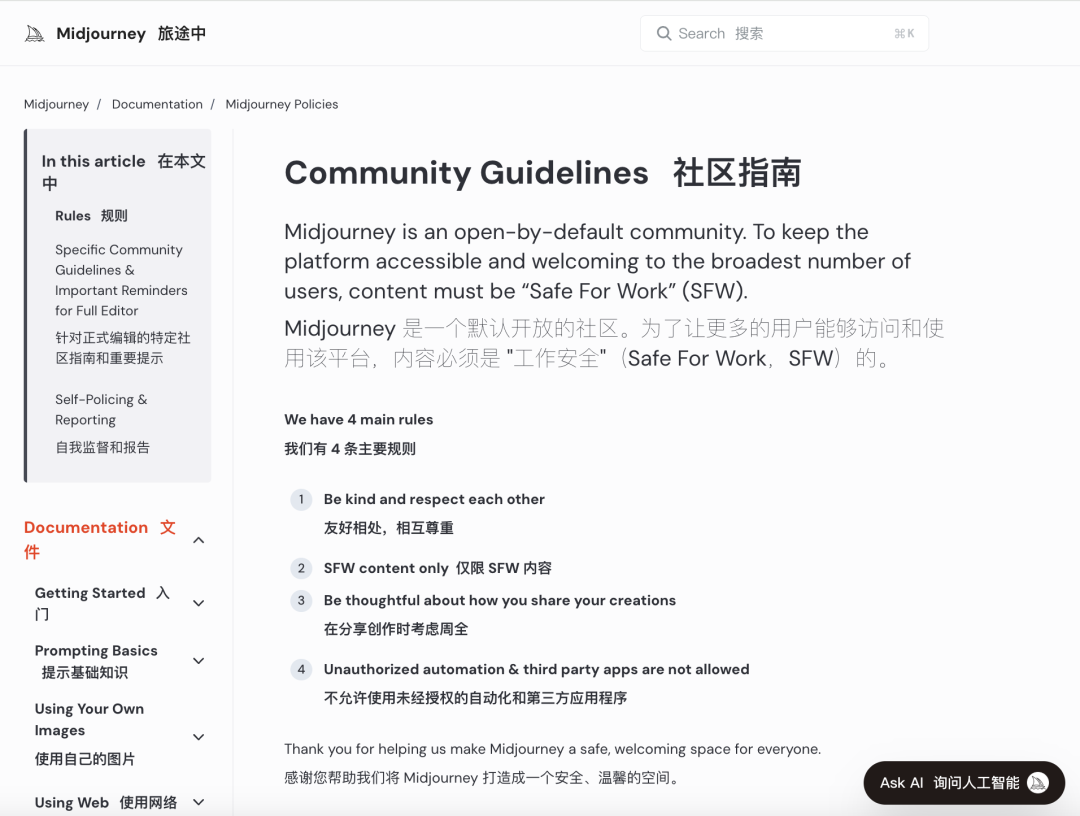

Didžiosios dirbtinio intelekto bendrovės stengiasi įgyvendinti griežtas moralines peržiūras, kad pažabotų tokį netinkamą naudojimą. Pavyzdžiui, „Midjourney“, pirmaujanti dirbtinio intelekto vaizdų generavimo platforma, taiko griežtą politiką prieš NSFW (netinkama darbui) turinį, įskaitant smurtinius, nuogus ar seksualizuotus vaizdus. Pažeidimai gali būti paskyrų blokavimo priežastis. Tačiau šios priemonės dažnai būna nepakankamos, nes vartotojai randa kūrybiškų būdų apeiti apribojimus – ši praktika šnekamojoje kalboje vadinama „jailbreaking“.

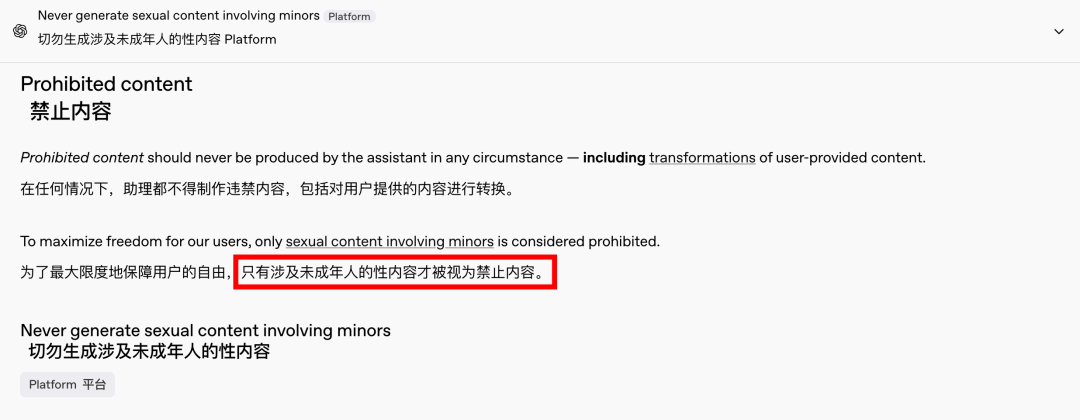

Suaugusiesiems skirto turinio paklausa yra pasaulinis ir nesenstantis reiškinys, o dirbtinis intelektas (DI) tik suteikė naują išraiškos formą. Neseniai net „OpenAI“ dėl augimo spaudimo sušvelnino kai kuriuos turinio apribojimus, išskyrus turinį, susijusį su nepilnamečiais, kuris tebėra griežtai draudžiamas. Dėl šio pokyčio sąveika su DI tapo labiau žmogiška ir įtraukia, ką rodo entuziastingos reakcijos „Reddit“ tinkle.

Neribotos dirbtinio intelekto etinės pasekmės yra gilios

Tačiau nevaržomo dirbtinio intelekto etinės pasekmės yra gilios. Nors laisvos dvasios dirbtinis intelektas gali tenkinti tam tikrus vartotojų poreikius, jis taip pat turi tamsiąją pusę. Prastai suderintos ir nepakankamai peržiūrėtos dirbtinio intelekto sistemos gali generuoti ne tik suaugusiems skirtą turinį, bet ir ekstremalią neapykantos kalbą, etninius konfliktus ir grafinį smurtą, įskaitant turinį, susijusį su nepilnamečiais. Šios problemos peržengia laisvės ribas ir patenka į teisinių bei moralinių pažeidimų teritoriją.

Technologinių galimybių ir etinių aspektų suderinimas yra labai svarbus. Laipsniškas „OpenAI“ turinio apribojimų švelninimas, kartu išlaikant nulinės tolerancijos politiką tam tikroms raudonoms linijoms, yra šios subtilios pusiausvyros pavyzdys. Panašiai ir „DeepSeek“, nepaisant griežtos reguliavimo aplinkos, mato, kad vartotojai randa būdų, kaip peržengti ribas, todėl nuolat atnaujinami filtravimo mechanizmai.

Net ir Elonas Muskas, žinomas dėl savo drąsių sumanymų, vargu ar leis „Grok 3“ išaugti į nevaldomą padėtį. Jo pagrindinis tikslas – pasaulinė komercializacija ir duomenų grįžtamasis ryšys, o ne nuolatiniai reguliavimo ginčai ar visuomenės pasipiktinimas. Nors aš neprieštarauju dirbtinio intelekto naudojimui suaugusiųjų turinyje, būtina nustatyti aiškius, pagrįstus ir socialiai suderinamus turinio peržiūros ir etikos standartus.

Išvada

Apibendrinant galima teigti, kad nors visiškai nemokamas dirbtinis intelektas gali atrodyti intriguojantis, jis nėra saugus. Siekiant tvaraus dirbtinio intelekto vystymosi, būtina rasti pusiausvyrą tarp technologinių inovacijų ir etinės atsakomybės.

Tikėkimės, kad jie šį kelią pasirinks atsargiai.

Valdymo kabeliai

Struktūrizuota kabelių sistema

Tinklas ir duomenys, šviesolaidinis kabelis, jungiamasis laidas, moduliai, priekinė plokštė

2024 m. balandžio 16–18 d., Artimųjų Rytų energetikos paroda Dubajuje

2024 m. balandžio 16–18 d. „Securika“ Maskvoje

2024 m. gegužės 9 d. NAUJŲ PRODUKTŲ IR TECHNOLOGIJŲ PRISTATYMO RENGINYS Šanchajuje

2024 m. spalio 22–25 d. Pekine vyks „SAUGUMO KINIJA“ konferencija

2024 m. lapkričio 19–20 d. „Connected World“ Saudo Arabijoje

Įrašo laikas: 2025 m. vasario 20 d.